Commission d'enquête relative aux révélations des uber files : l'ubérisation, son lobbying et ses conséquences

Réunion du jeudi 6 avril 2023 à 9h00

La réunion

Jeudi 6 avril 2023

La séance est ouverte à neuf heures.

(Présidence de M. Frédéric Zgainski, vice-président de la commission)

La commission d'enquête entend, à huis clos, M. Mathias Moulin, secrétaire général adjoint de la Commission nationale de l'informatique et des libertés, accompagné de Mme Astrid Mariaux, cheffe du service des contrôles des affaires économiques et de Mme Sophie Genvresse, cheffe du service de l'exercice des droits et des plaintes

Nous avons l'honneur d'accueillir M. Mathias Moulin, secrétaire général adjoint de la Commission nationale de l'informatique et des libertés (Cnil), accompagné de Mme Astrid Mariaux, cheffe du service des contrôles des affaires économiques et de Mme Sophie Genvresse, cheffe du service de l'exercice des droits et des plaintes.

À partir du 10 juillet 2022, plusieurs membres du consortium international des journalistes d'investigation ont publié ce qu'il est désormais convenu d'appeler les Uber files. S'appuyant sur 124 000 documents internes à l'entreprise américaine datés de 2013 à 2017, cette enquête a dénoncé un lobbying agressif d'Uber pour implanter en France, comme dans de nombreux pays, des véhicules de tourisme avec chauffeur (VTC) venant concurrencer le secteur traditionnel du transport public particulier de personnes, réservé jusqu'alors aux taxis.

D'une part, notre commission d'enquête cherche à identifier l'ensemble des actions de lobbying menées par Uber afin de s'implanter en France, ainsi que le rôle des décideurs publics de l'époque. Nous émettrons des recommandations concernant l'encadrement des relations entre décideurs publics et représentants d'intérêts.

D'autre part, cette commission a pour buts d'évaluer les conséquences économiques, sociales et environnementales du développement du modèle Uber en France, d'examiner les réponses apportées par les décideurs publics en la matière et de formuler des recommandations.

Votre audition s'inscrit dans cette seconde optique, compte tenu du fait que les plateformes d'emplois numériques telles qu'Uber utilisent des systèmes automatisés de données pour faire correspondre l'offre et la demande de travail.

Leur usage sert à la fois à assigner des tâches aux personnes qui travaillent par leur intermédiaire, le cas échéant, à les surveiller et à les évaluer, ainsi qu'à prendre des décisions les concernant. Ces pratiques sont souvent qualifiées de « gestion algorithmique ».

Si une telle gestion renforce l'efficacité du rapprochement de l'offre et de la demande, elle affecte de manière significative les conditions et le cadre du travail des plateformes. La gestion algorithmique peut ainsi masquer l'existence d'un lien de subordination et d'un contrôle exercé par la plateforme sur les personnes qui travaillent, comme l'a souligné à plusieurs reprises la jurisprudence de la Cour de cassation. Les éventuels stéréotypes sexistes et la discrimination véhiculés par la gestion algorithmique peuvent également amplifier les inégalités entre les hommes et les femmes.

Il ressort de nos auditions que la transparence est actuellement insuffisante en ce qui concerne les systèmes de surveillance et de prise de décision automatisés. Les personnes concernées, en particulier les chauffeurs VTC et les livreurs, se sont plaintes de ne pas disposer d'un accès facile à leurs données personnelles et aux données commerciales et estiment ne pas bénéficier de voies de recours pertinentes contre les décisions de ces systèmes.

La gestion algorithmique est un phénomène relativement nouveau et peu réglementé dans l'économie des plateformes, exception faite des règles de l'Union européenne prévues par le règlement général sur la protection des données (RGPD). Cette situation pose des problèmes tant pour les travailleurs salariés que pour les travailleurs non-salariés exerçant leur activité par l'intermédiaire des plateformes de travail numériques.

La Commission européenne a d'ailleurs proposé une directive relative à l'amélioration des conditions de travail dans le cadre du travail via une plateforme, afin de renforcer non seulement leur transparence et la responsabilité de leur gestion algorithmique mais aussi les droits de leurs utilisateurs.

Pouvez-vous, sur ce point, nous dresser un état des lieux de la situation en France ? Avez-vous reçu des plaintes de la part des travailleurs des plateformes, à l'instar des cinq plaintes déposées par M. Ben Ali et son avocat, maître Giusti ? Pouvez-vous nous les présenter et nous préciser l'état de la procédure ?

Que pensez-vous des améliorations proposées par la Commission européenne dans son projet de directive ? Le texte est-il suffisamment ambitieux et précis ? S'articule-t-il correctement avec les dispositions du RGPD ? Élargira-t-il les missions de la Cnil ou son champ d'intervention ?

Je vous rappelle que l'article 6 de l'ordonnance du 17 novembre 1958 relative au fonctionnement des assemblées parlementaires impose aux personnes entendues par une commission d'enquête de prêter le serment de dire la vérité, toute la vérité, rien que la vérité. Je vous invite donc à lever la main droite et à dire : « Je le jure. »

(M. Mathias Moulin, Mme Astrid Mariaux et Mme Sophie Genvresse prêtent successivement serment.)

La question des algorithmes concerne de nombreuses activités de la Cnil mais je souhaite tout d'abord replacer le cas d'Uber dans le contexte général de notre action.

Notre commission compte, en 2022, 270 agents pour un budget de 24 millions d'euros et remplit quatre missions principales : l'accompagnement et le conseil des pouvoirs publics, des associations et des entreprises ; l'information du public et l'éducation numérique ; le suivi et la veille de l'innovation ; l'instruction des plaintes et l'exécution des contrôles.

L'activité répressive mobilise une centaine d'agents qui traitent chaque année, depuis la mise en place du RGPD, entre 12 000 et 14 000 plaintes. Ces dernières touchent tous les aspects de la vie, la Cnil n'étant pas un régulateur sectoriel, contrairement à l'Autorité de régulation de la communication audiovisuelle et numérique (Arcom), dans la mesure où les données personnelles touchent à tous les aspects de notre vie.

Nous adressons chaque année entre 100 et 150 mises en demeure aux entreprises, aux administrations ou aux associations et obtenons une mise en conformité dans 95 % des cas. Nous délivrons aussi entre 15 et 20 sanctions par an, même si la finalité de l'action répressive est moins la punition que la mise en conformité, ce qui explique notre méthode en entonnoir – 14 000 plaintes, entre 300 et 400 contrôles, entre 100 et 150 mises en demeure et 15 à 20 sanctions.

Depuis 2018, le montant total des amendes infligées par la Cnil représente 500 millions d'euros.

Avant l'entrée en vigueur du RGPD, Uber a connu deux vagues de mesures correctrices de la Cnil, laquelle a procédé au contrôle de la société en 2016 et en 2017 au sujet des données collectées par ses chauffeurs ainsi que du traitement de celles de ses clients.

[Confidentiel]

La deuxième campagne de contrôle, qui concernait des aspects de sécurité, s'est conclue par une amende de 400 000 euros, dont la presse s'est fait l'écho.

Depuis l'entrée en vigueur du RGPD les demandes sont traitées au sein d'un guichet unique, lequel procède à la répartition entre l'autorité cheffe de file, dont la juridiction est celle du lieu d'implantation de l'établissement principal de la société, et les autres autorités concernées – parmi lesquelles, en l'espèce, la Cnil. L'établissement principal d'Uber étant aux Pays-Bas, c'est l'autorité néerlandaise qui a compétence sur le système de traitement transfrontalier des données au sein de l'Union européenne.

Elle doit en conséquence conduire les investigations et instruire les plaintes en coopération avec les autorités concernées et prendre les mesures correctrices. Ce dispositif modifie les moyens mobilisés et la chronologie de notre action, dont la durée est allongée par les instructions menées dans ce cadre coopératif, chose nécessaire compte tenu du caractère européen de l'opération et de la multiplication des échanges. Le rapport indirect qu'entretient l'autorité concernée à l'affaire contribue également à l'allongement de la procédure.

Les plaintes qu'une centaine de chauffeurs nous ont adressées concernaient trois sujets en particulier : la qualité de l'information fournie et les modalités d'exercice des droits ; le transfert des données hors de l'Union européenne ; et la prise de décision automatique de déconnecter certains chauffeurs en raison de leur notation ou d'une suspicion de fraude.

La diversité des sujets traités contribue à la complexité de notre activité, encore accrue par plusieurs processus de recevabilité qui jalonnent les différentes étapes de l'instruction, d'autant que les demandes doivent être conformes aux droits français et néerlandais.

L'autorité néerlandaise compte 175 agents, soit moins que la Cnil, qui mobilise de son côté deux agents à mi-temps sur le seul cas d'Uber.

Lorsque nous faisons face à de grands groupes comme Uber ou à des géants du numérique – nous avons déjà eu affaire à la plupart des Gafam (Google, Apple, Facebook, Amazon et Microsoft) –, nous devons instruire de grands volumes de documents et nous nous heurtons à une batterie d'avocats qui font feu de tout bois, d'où la nécessité, pour nous, de constituer des dossiers très robustes.

Ces plaintes ont donné lieu à une trentaine de réunions avec l'autorité néerlandaise, avec qui nous avons réalisé des contrôles sur place. De ce point de vue, la pandémie et les confinements ont nui à la fluidité des instructions.

Le cas des plateformes n'est pas spécifique au regard du RGPD, dans la mesure où ce règlement s'applique à elles comme à tout responsable de traitement de données à caractère personnel permettant l'identification directe ou indirecte de la personne, qu'il s'agisse d'une utilisation, d'un stockage, d'un transfert ou d'une suppression de données personnelles.

Les traitements mis en œuvre par Uber entrent donc dans le périmètre du RGPD et concernent trois catégories de personnes : les salariés, les clients et les chauffeurs. La dématérialisation presque totale de son service constitue néanmoins une particularité, le client n'ayant de contact physique qu'avec le chauffeur.

L'utilisation d'une application implique un traitement des données personnelles en vue de la mise en relation d'un client et d'un chauffeur, dispositif dont l'efficacité repose sur le recours à des algorithmes doublés d'un système de notation. Aussi le traitement des données constitue-t-il un maillon essentiel de l'activité d'Uber et, plus généralement, de l'ensemble des plateformes.

Toutes les dispositions du RGPD s'appliquent à Uber s'agissant des droits qu'elles offrent aux clients, aux salariés et aux chauffeurs, en particulier quant à l'accès à l'information. Les plaintes formées sur ce fondement mettaient en cause la qualité des informations délivrées, la difficulté d'y avoir accès du fait d'un parcours complexe mais aussi l'incomplétude des réponses fournies et le fait que certaines d'entre elles n'étaient délivrées qu'en anglais. Plus généralement, la nature des données communiquées, leur format et leur incomplétude posaient problème.

[Confidentiel]

La concertation au niveau européen a donc pour inconvénient d'allonger les délais de traitement mais pour avantage de consolider les plaintes ?

Tout à fait, et elle permet également une certaine cohérence. La dimension européenne de cette procédure lui conférant une portée globale, les autorités peuvent prendre des mesures touchant l'ensemble des plateformes qui opèrent au sein de l'Union européenne. À la suite des investigations, Uber s'est ainsi mise en conformité en revoyant l'ensemble de son processus d'information et en le rendant entièrement disponible en français. Les différents points à l'origine des plaintes ont donc été résolus au fil de l'instruction.

Si la mise en conformité d'Uber est totale, la décision proposée aura pour but de sanctionner ses irrégularités passées au regard du RGPD. Dans ce cas, aucune injonction de faire ne sera prononcée.

La Cnil peut aussi décider d'injonctions sous astreinte, pour un montant pouvant s'élever à 100 000 euros par jour, afin d'obliger l'entreprise à se mettre en conformité. L'autorité néerlandaise peut très bien, le jour où elle soumettra le projet de décision aux autres autorités européennes, prononcer de telles astreintes à l'encontre d'Uber.

La deuxième catégorie de plainte, relative aux transferts de données hors de l'Union européenne, s'appuie sur l'arrêt dit « Schrems 2 » de la Cour de justice de l'Union européenne (CJUE) qui a constaté un niveau insuffisant de protection des données aux États-Unis et invalidé le bouclier de protection des données dit « privacy shield ». Par conséquent, les entreprises qui y transféraient des données doivent prendre des mesures complémentaires pour garantir leur protection.

Uber avait en effet recours à des moyens de traitement situés sur le territoire américain, d'autant que l'entreprise était soumise à l'extraterritorialité des lois américaines, ce qui permettait aux États-Unis d'obtenir des informations stockées en Europe, notamment à la faveur du Cloud Act – Clarifying Lawful Overseas Use of Data Act.

[Confidentiel]

Le principe d'une décision automatisée est interdit par le RGPD, qui admet cependant trois exceptions. La première, fondée sur le consentement libre et informé, est ici à écarter puisque cet accord n'était pas recueilli compte tenu des carences dont nous parlions ; la deuxième exception repose sur une autorisation conférée par le droit de l'Union européenne, ce qui n'était pas le cas en l'espèce ; et la troisième, qui gagnerait à être étudiée, concerne les décisions nécessaires à l'exécution d'un contrat.

La conclusion de l'analyse juridique a été retardée par les procédures judiciaires en cours devant les juridictions néerlandaises. Même si nous sommes une autorité administrative indépendante, nous suspendons généralement nos travaux lorsqu'une procédure judiciaire est en cours sur un de nos sujets d'investigation. Ainsi, lorsque le Conseil d'État est saisi d'un dossier sur lequel nous enquêtons, nous attendons sa décision afin de ne pas courir le risque d'agir dans un sens différent du sien, d'autant qu'il est notre juridiction d'appel et de recours.

De même, les juridictions ne se sentent pas toujours à l'aise à l'idée de prendre une décision en sachant qu'une procédure est simultanément menée par une autorité administrative indépendante.

Pour ce qui concerne les déconnexions, la cour d'appel néerlandaise a rendu avant-hier la décision que nous avions longtemps attendue et qui se trouve être plutôt favorable à la protection des données telle que nous la concevons. La juridiction a en effet considéré que les dispositifs de déconnexion avaient un impact significatif sur les personnes visées et que, même s'il y avait intervention humaine, il ne suffisait pas que quelqu'un procède à une vague vérification depuis un bureau à Cracovie pour considérer qu'il ne s'agissait pas d'un processus entièrement automatisé. En conséquence, elle a considéré que ce régime de décision automatisée ne répondait pas aux critères du RGPD.

L'autorité néerlandaise attendait elle aussi cette décision pour finaliser son analyse juridique. Nous allons donc pouvoir désormais avancer plus vite avec un dispositif robuste, puisqu'une partie du contentieux, et la plus complexe, a déjà été quelque peu purgée.

[Confidentiel]

Les améliorations proposées par la Commission européenne dans son projet de directive sont-elles, selon vous, assez ambitieuses et assez précises ? Comment s'articulent-elles avec les dispositions du RGPD ? Vos missions ou votre champ d'intervention évolueront-ils de ce fait ?

Il me semble préférable de vous faire parvenir une contribution écrite sur ces questions, dont le collège de la Cnil n'a pas été saisi et sur lesquelles il n'a donc pas rendu d'avis. Bien que des communications soient parfois faites en séance plénière, devant le collège, afin de « prendre la température », cela n'a pas été le cas en l'espèce. Les services ont commencé à y travailler mais certains points de l'analyse doivent encore être validés ou nécessitent des clarifications, d'où ma préférence pour une contribution écrite. Rien, toutefois, ne me semble véritablement antagoniste avec nos pouvoirs.

D'une manière générale, la Cnil a l'habitude de travailler dans un contexte d'articulation avec d'autres textes. Ainsi, l'un des premiers dossiers que j'ai eu à instruire lorsque je suis arrivé en tant que juriste à la Cnil concernait une directive instaurant la géolocalisation des bateaux de pêche de plus de dix-huit mètres : le problème de protection des données tenait au fait que, ces bateaux appartenant le plus souvent à des artisans, géolocaliser un bateau revenait à géolocaliser une personne. La protection des données est omniprésente et s'articule toujours avec d'autres domaines, comme le droit de la santé, du travail ou de l'environnement.

Étant donné qu'il s'agit ici d'une directive européenne et que celle-ci devra, en tant que telle, être transposée, c'est au moment de cette transposition que la Cnil travaillera.

Nous travaillons aussi beaucoup avec le Parlement, qui nous a auditionnés à une dizaine de reprises depuis le début de l'année. Nous avons recruté, en la personne de Mme Berrichi, une collaboratrice très compétente pour suivre notamment ces questions, et nous assurons une veille parlementaire. Je ne doute pas que les éventuels points de frottement se résoudront, comme il en a toujours été.

Je regrette donc de ne pouvoir apporter de réponse très précise à votre question. La contribution écrite que nous vous fournirons aura nécessairement un caractère technique. Il me semble en tout cas que les sujets abordés relèveront davantage de détails que de problèmes systémiques.

La question est très complexe et, comme vous l'avez dit, aucun domaine n'est centré sur lui-même, la question des données pouvant toucher à d'autres problèmes relevant par exemple du droit du travail ou de la fiscalité.

Si je comprends bien, toutes les plaintes émanant des chauffeurs, qu'elles aient été déposées en France ou dans un autre pays de l'Union européenne, seront traitées par les autorités des Pays-Bas, pays qui abrite le siège d'Uber, en collaboration avec celles des États membres concernés, et la décision s'imposera ensuite à tous. Ainsi, à la suite de la décision de la cour d'appel d'Amsterdam jugeant que la déconnexion des livreurs n'est pas conforme à l'article 22 du RGPD, Uber sera mis en demeure de se mettre en conformité dans l'ensemble des États membres et cette décision s'imposera aussi aux dossiers déposés à d'autres périodes s'il y a eu manquement à cet article. Est-ce bien cela ?

Il ne s'agit pas d'un traitement local, c'est-à-dire s'appliquant uniquement sur le territoire français. Si cela avait été le cas, la Cnil aurait été compétente et aurait alors indiqué à la partie néerlandaise que, selon notre analyse, le dossier relevait d'un traitement local. Ce dossier aurait alors été traité par la France. Or il s'agit ici d'un traitement transfrontalier, mécanisme systémique auquel recourt Uber pour tous ses chauffeurs. L'assiette de la décision de la cour d'appel d'Amsterdam est purement nationale mais l'autorité néerlandaise de protection des données doit intégrer cette décision dans son logiciel d'analyse des plaintes, et c'est là que réside la rétroaction systémique de cette mesure : prise par l'autorité néerlandaise à l'encontre d'Uber au titre d'un traitement transfrontalier, elle s'appliquera de manière générale à cette entreprise pour les traitements appliqués dans l'Union européenne et son effet se fera donc sentir pour les chauffeurs tant français que néerlandais, grecs ou espagnols.

Outre les plaintes portant sur des déconnexions, a également été largement évoqué le manque de transparence du fonctionnement des algorithmes régissant les changements de tarif des courses ou l'accès des chauffeurs à certaines courses. La mise en relation du chauffeur et du client par la plateforme et la tarification semblent en effet obéir à des critères complexes, dont le chauffeur n'a pas connaissance et qui ne dépendent pas seulement des horaires ou du nombre de chauffeurs présents. Cette opacité, qui porte sur des éléments déterminants du rapport contractuel et de la rémunération des chauffeurs, fait-elle également l'objet d'une des plaintes dont la Cnil est saisie ?

Les plaintes ont des assiettes assez larges. La question de la transparence des algorithmes se pose pour tous les dispositifs reposant sur des algorithmes, qui sont des sortes de boîtes noires dans lesquelles il est difficile de discerner le processus de décision, les critères utilisés et les modalités d'entraînement de l'intelligence artificielle. Cette question relève de l'article 22 du RGPD et de l'obligation d'information. Dès lors, en effet, que sont appliqués des processus informatisés, on doit pouvoir avoir accès à la logique qui les sous-tend, dans la limite, cependant, du secret des affaires. Il s'agit de trouver un point d'équilibre permettant à la fois d'avoir accès à un certain niveau d'information et de contester les mesures prises pour un processus automatisé, d'accéder à cette logique et de demander l'intervention d'un être humain dans ce processus, sous réserve de la préservation du modèle d'affaires de l'entreprise.

Jusqu'à présent, la Cnil a été saisie de plaintes portant sur les déconnexions entièrement automatisées : les chauffeurs réalisent subitement, sans explication ni même nécessairement d'information préalable, qu'ils sont déconnectés et ne peuvent plus prendre de courses.

Quant à l'usage des algorithmes, employés par exemple pour définir le prix des courses, il a été évoqué dans le cadre des échanges nombreux que nous avons eus avec Me Giusti et M. Ben Ali à propos de la gestion des plaintes, notamment pour les questions de profilage, mais nous n'avons pas encore été saisis de plaintes.

Une décision prise en première instance aux Pays-Bas indiquait que les déconnexions temporaires ne pouvaient être considérées comme des décisions entièrement automatisées ayant un impact significatif sur la vie des chauffeurs, puisqu'elles n'étaient que temporaires. Dans une décision très attendue tant par la partie néerlandaise que par la Cnil, la cour d'appel est revenue sur cette décision, considérant qu'elle avait un impact négatif sur les personnes concernées.

Cette décision a été rendue voilà deux jours, en langue néerlandaise, et nous ne disposons pour l'instant, pour l'étudier, que d'une traduction un peu légère.

Il s'agit d'une décision importante, dans laquelle la cour souligne que la société Uber manque totalement de transparence, se réfugiant derrière le secret commercial pour ne pas donner d'informations, argument que la cour juge non valable. Reste à fixer le degré de communication nécessaire : peut-être la société ne doit-elle pas tout expliquer à propos de son algorithme car ce serait porter atteinte au secret des affaires, mais elle ne peut pas non plus refuser de communiquer quoi que ce soit sous ce prétexte.

Les autorités de protection des données, et plus particulièrement la Cnil, sont confrontées à l'opacité de la prise de décision des algorithmes. La Cnil est compétente, puisqu'il y a traitement de données à caractère personnel, et travaille actuellement avec le pôle de l'expertise numérique rattaché aux ministères de la Culture et de l'Économie en vue de développer des outils d'analyse qui nous aideraient. Nous avons pris pour ce faire les exemples du choix des chauffeurs ou de la durée de la livraison d'une course, afin de voir quels sont les critères pris en compte pour entraîner la décision. Nous travaillons sur ces questions mais ce n'est pas simple.

Concrètement, quels sont les droits des chauffeurs et des livreurs face à la plateforme s'ils veulent avoir accès au fonctionnement de l'algorithme ?

De plus, lors de la création de l'Autorité des relations sociales des plateformes d'emploi (Arpe), qui se présente comme le cadre du dialogue social permettant de faire évoluer les droits des travailleurs de ces plateformes, avez-vous été sollicités pour collaborer avec elle sur la question des droits des travailleurs ? En effet, la question de l'accès aux données et à la boîte noire des algorithmes revient très souvent dans les échanges que nous avons eus avec les chauffeurs et les livreurs. Vous auriez ainsi pu être sollicités au moins au titre de votre mission de veille technologique.

Les droits des chauffeurs sont les mêmes que ceux de toute personne concernée par un traitement informatisé des données personnelles la concernant : droits d'accès, de rectification, d'opposition, d'effacement et de portabilité.

Le droit d'accès présente deux versants. Il s'agit, d'une part, de l'accès à l'information et de la transparence du traitement. Certaines informations qui doivent être délivrées et portant sur le moment et la profondeur de l'information varient selon que la collecte est directe ou indirecte mais la personne concernée doit être informée des finalités du traitement, de ses destinataires, d'un éventuel transfert de données hors de l'Union européenne et de ses propres droits. Elle doit également être informée si un processus automatisé est mis en place.

Par ailleurs, le droit d'accès ne donne pas accès à des documents à proprement parler, mais à des données, même s'il est parfois plus facile pour l'organisme qui les détient de transmettre le document que de retraiter l'information et les données pertinentes pour les communiquer.

Vous dites donc que les chauffeurs doivent être informés si un processus informatisé s'applique mais cela ne signifie pas pour autant que l'information qu'ils reçoivent porte sur la manière dont le processus est informatisé. C'est là que le bât blesse car c'est sans doute à ce stade qu'Uber invoque le droit des affaires.

En fonction des impacts, les intéressés peuvent avoir une information sur la logique qui sous-tend le processus et l'algorithme. Tout dépend du niveau de profondeur. La société Uber indiquera les limites de l'information qu'elle estime pouvoir communiquer, le reste étant, selon elle, couvert par le secret des affaires. De son côté, le chauffeur pourra considérer que ce n'est pas suffisant et qu'il n'a pas un accès suffisant aux critères sur lesquels se fonde la décision. Puis le régulateur – par exemple Cnil ou une autorité judiciaire – jugera si le curseur a été bien ou mal placé.

Il est donc possible d'avoir accès à certaines informations, de contester le processus et d'y intégrer une intervention humaine.

Pour les autorités de protection des données, le prisme d'entrée est l'article 22 du RGPD, déjà évoqué, qui s'applique lorsqu'une décision individuelle entièrement automatisée peut avoir un impact significatif sur une personne. C'était là le premier degré de difficulté auquel nous étions confrontés, le tribunal néerlandais de première instance ayant en effet jugé qu'il n'y avait pas d'impact significatif, même si un chauffeur temporairement déconnecté – et même pour une durée assez longue – perdait ainsi des revenus.

La remise en cause de cette appréciation par la cour d'appel a ouvert le deuxième champ d'application du texte : dès lors qu'il y a un impact, des garanties supplémentaires doivent être assurées, à savoir une intervention humaine et la possibilité de contester la décision – ce qui suppose d'avoir connaissance des critères fondant cette dernière. L'analyse du jugement de la cour d'appel est toutefois encore à étudier pour en mesurer l'impact. En outre, nous ne sommes pas liés par cette décision, même si nous pouvons nous en servir pour comprendre quel niveau d'information il convient de donner aux chauffeurs pour leur assurer une décision plus juste.

Le premier des droits est le droit d'obtenir une information. La plateforme doit notamment indiquer aux intéressés, sans qu'ils aient à le demander, qu'ils font l'objet d'une décision entièrement automatisée qui aurait un impact significatif, leur fournir des éléments de la logique sous-jacente et les informer des conséquences possibles. La cour d'appel a reconnu qu'il s'agissait d'une décision automatisée, même si elle était temporaire, et qu'il faudrait s'assurer qu'une information préalable avait bien été fournie. Il y a donc lieu de poursuivre l'analyse de cette décision.

Je voudrais compléter ma question qui visait à savoir si vous aviez été sollicités par l'Arpe à ce propos. Si la directive européenne sur la présomption de salariat, actuellement au stade d'une recommandation adoptée par le Parlement européen, requalifiait en salariat le statut des travailleurs des plateformes, substituant un contrat de travail à une relation commerciale entre ces dernières et les chauffeurs, cela induirait-il des changements de droits en matière de traitement des données ?

À ma connaissance nous n'avons pas de contacts particuliers avec l'Arpe, ni nous ni cette autorité n'en ayant sollicité. Le seul contact que nous ayons eu, assez indirect, a été en octobre 2021, lorsque le ministère du Travail, de l'Emploi et de l'Insertion a saisi la Cnil pour avis d'un projet de décret en Conseil d'État relatif à l'organisation et aux conditions de déroulement du scrutin destiné à mesurer l'audience des organisations de travail des plateformes. Nous avons alors rendu une délibération sur ce projet de décret, qui impliquait un traitement automatisé des données.

Vous évoquiez la possibilité que les traitements algorithmiques recouvrent des discriminations. Ce sont là des questions que nous traitons davantage avec le Défenseur des droits, qui est pleinement compétent en la matière. Nous avons pu échanger avec le Défenseur des droits à l'occasion de contrôles que nous avons réalisés, par exemple, sur l'accès à l'emploi. En effet, certains algorithmes trient automatiquement des CV, y compris en vidéo. Nous avons ainsi constaté, à l'occasion d'un contrôle, que les personnes vivant dans la région parisienne étaient valorisées par rapport à d'autres car l'algorithme avait été entraîné avec des personnes de cette région, de telle sorte que la présence d'un accent, méridional par exemple, faisait baisser la notation et le résultat du candidat car elle était interprétée comme un problème d'élocution, alors qu'il ne s'agissait que d'un problème d'entraînement de l'algorithme. De tels biais ne procèdent pas d'une volonté de discrimination de la part de l'organisme recruteur mais d'un entraînement de l'algorithme.

D'autres biais peuvent être liés au sexe. Ainsi, il y a fort à parier que 90 % des CV d'une base d'entraînement de CV d'ingénieurs seront des CV d'hommes, de telle sorte que l'algorithme en déduira bêtement que, pour être ingénieur, il faut être un homme ! Ce sont là des éléments que nous contrôlons et à propos desquels nous dialoguons avec le Défenseur des droits mais nous n'avons pas eu à traiter ces questions avec l'Arpe.

Quant à votre deuxième question, qui était de savoir si la requalification du contrat aurait une influence sur l'application du RGPD, la réponse est : oui et non. Se posent, là encore, des problèmes d'articulation : dans le cadre d'une relation de travail, la base légale de certains traitements changera car ces traitements seront imposés par le code du travail, qui prévoit notamment des registres d'employés et divers traitements de données à caractère personnel pour la gestion de la paie, de la santé au travail ou de la prévention, ainsi que des durées de conservation, par exemple pour les bulletins de paie ou certaines évaluations, les modalités d'information et l'implication des instances représentatives. La requalification en salariat aura donc un impact mais ne changera pas fondamentalement les droits des personnes ni les obligations en termes de sécurité et d'information.

Les membres de la commission d'enquête pourront vous adresser des questions complémentaires, auxquelles je vous remercie de répondre par écrit.

La séance s'achève à dix heures quinze.

Membres présents ou excusés

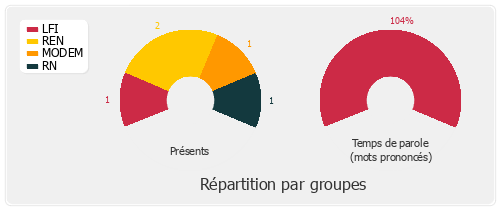

Présents. – Mme Aurore Bergé, M. Benjamin Haddad, Mme Béatrice Roullaud, Mme Danielle Simonnet, M. Frédéric Zgainski

Excusés. – Mme Anne Genetet, Mme Amélia Lakrafi, M. Olivier Marleix, Mme Valérie Rabault